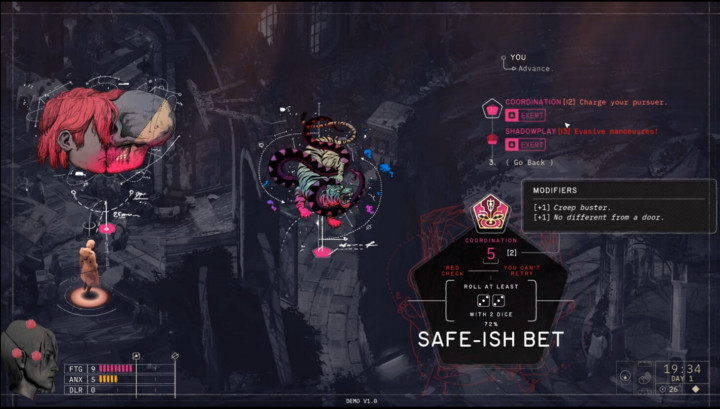

Berbeda dengan sistem sebelumnya, teknologi baru ini mampu memantau berbagai elemen dalam game secara bersamaan dan real-time.

Roblox kini menggunakan sistem multimodal moderation, yaitu AI yang dapat menganalisis satu “adegan” secara utuh, bukan hanya satu objek. Artinya, sistem akan melihat kombinasi Avatar pemain, objek atau elemen 3D, serta teks dan interaksi dalam game.

Pendekatan ini penting karena konten di Roblox sering kali merupakan gabungan dari berbagai elemen. Secara terpisah mungkin terlihat normal, tetapi saat digabungkan bisa melanggar aturan komunitas.

Jika AI mendeteksi perilaku atau konten bermasalah yang terjadi berulang dalam satu sesi permainan, Roblox akan mengambil tindakan.

Alih-alih memblokir seluruh game, sistem hanya akan menutup server tempat pelanggaran terjadi. Cara ini dinilai lebih efektif karena tidak mengganggu pemain lain yang tidak melanggar aturan.

Sejak sistem ini diterapkan, Roblox diklaim mencatat sekitar 5.000 server dihentikan setiap hari karena pelanggaran terhadap standar komunitas.

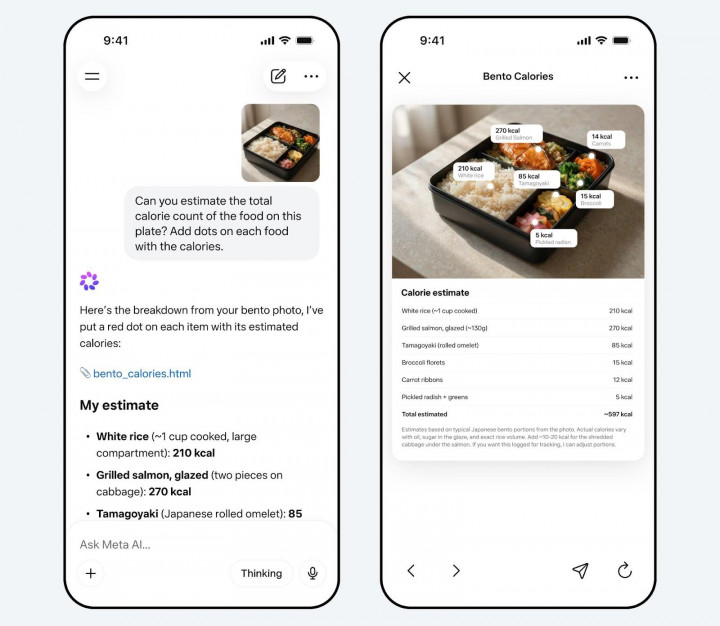

Selain memantau pemain, Roblox juga memberikan alat baru untuk kreator game melalui dashboard.

Fitur ini memungkinkan kreator melihat jumlah server yang ditutup akibat perilaku bermasalah. Dengan data tersebut, mereka bisa mengevaluasi fitur dalam game, seperti sistem avatar atau interaksi pengguna, agar lebih aman.

Roblox juga menggandeng Keyword Studios, Riot Games, dan peneliti Rachel Kowert untuk mengembangkan program pelatihan bagi moderator komunitas. Program ini dirancang untuk membantu pengelola komunitas memahami perilaku pemain dan menerapkan praktik moderasi yang lebih efektif.

Ke depan, Roblox berencana mengembangkan sistem yang tidak hanya menghentikan server, tetapi juga dapat mengidentifikasi pemain yang melakukan pelanggaran secara spesifik.

Dengan begitu, tindakan bisa lebih tepat sasaran tanpa mengganggu keseluruhan pengalaman bermain.

Cek Berita dan Artikel yang lain di

Google News