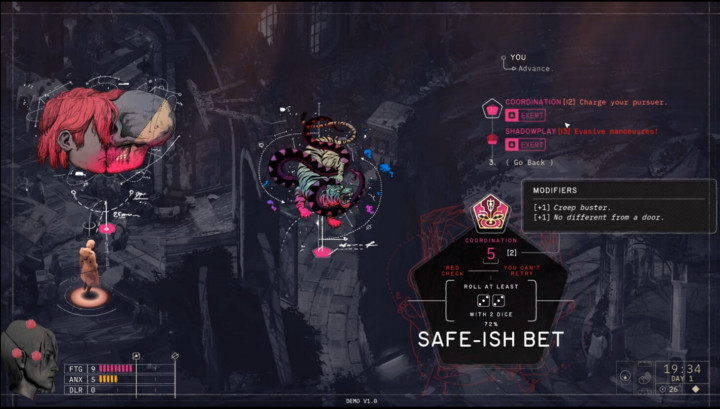

Dalam sebuah diskusi panel di ajang Singapore International Cyber Week 2025 x GovWare, para eksekutif dari Ensign InfoSecurity mengupas tantangan implementasi teknologi canggih ini. AI agentik bukanlah solusi plug-and-play yang bisa langsung dipasang dan dipercaya.

Tan Ah Tuan, EVP of Ensign Labs di Ensign InfoSecurity, menyoroti salah satu risiko paling mengkhawatirkan: kemampuan AI dalam mengambil keputusan etis. "AI masih tidak sangat bagus dalam membuat keputusan etis," ujarnya.

Ia memaparkan sebuah skenario dilematis yang mengerikan. Bayangkan, sebuah solusi AI agentik yang otonom mendeteksi adanya virus di server rumah sakit. Berdasarkan praktik terbaik keamanan, AI itu mungkin memutuskan untuk segera mengisolasi server perangkat perangkat mesin penyokongan hidup.

"Tentu saja itu bukan keputusan yang paling pintar," tegas Tan Ah Tuan. Contoh ini menggarisbawahi perlunya batasan yang jelas dan kemampuan untuk membimbing autonomi dan tindakan penyelesaian agetik ini.

Selain dilema etis, tantangan besar lainnya adalah halusinasi yang melekat pada Large Language Models (LLM), yang merupakan komponen inti dari AI agentik. Halusinasi, atau kecenderungan AI untuk menghasilkan informasi yang salah namun meyakinkan, bisa menjadi bencana dalam konteks keamanan siber.

Tan Ah Tuan menjelaskan bahwa LRM (model bahasa) bisa saja memberikan penilaian yang salah. Misalnya, AI bisa salah mengira anomali biasa sebagai serangan siber berbahaya, atau sebaliknya, mengabaikan serangan nyata karena dianggap sebagai kesalahan data. Jika sebuah organisasi terlalu dipercaya dengan halusinasi tersendiri dari AI, dampaknya bisa fatal.

Secara ironis, semakin besar ketergantungan organisasi terhadap solusi AI ini, masalahnya justru bisa menjadi lebih besar ketika terjadi kegagalan.

Untuk mengatasi risiko ini, para pembicara tidak menyarankan untuk meninggalkan AI, melainkan mengimplementasikannya dengan sangat hati-hati. Paul Tan, EVP of Government & Singapore Enterprises di Ensign InfoSecurity, menekankan bahwa AI harus diberi konteks organisasi yang lengkap agar menjadi kuat.

Lebih lanjut, timnya di Ensign berupaya menghindari dampak halusinasi dengan tidak mengandalkan AI semata. Solusinya adalah dengan melakukan penyelesaian agentik, karena kita memiliki banyak halusinasi penyelesaian agentik, serta penyelesaian penyokongan hidup.

Dengan kata lain, AI agentik digunakan bersamaan dengan sistem pemantauan langsung. Pendekatan hibrida ini memungkinkan validasi silang untuk memastikan AI terus berjalan dengan benar dan membuat keputusan yang tepat.

Secanggih apa pun teknologinya, AI tetaplah alat. Implementasinya dalam pertahanan siber menuntut pengawasan manusia yang ketat, pemahaman mendalam akan keterbatasannya, dan kerangka kerja etis yang kuat untuk mencegah keputusan otonom yang dapat membawa bencana.

Cek Berita dan Artikel yang lain di

Google News