Sikap proaktif Indonesia ini diharapkan dapat mengubah sektor industri dan mendorong pertumbuhan ekonomi. Komitmen ini kemudian dipertegas dengan disusunnya rencana implementasi AI yang komprehensif di Indonesia.

Menurut hasil riset Accenture, hampir semua eksekutif Indonesia (99%) setuju bahwa perangkat lunak dan layanan yang didukung oleh model dasar kecerdasan buatan (AI) akan secara signifikan meningkatkan inovasi dan kreativitas dalam organisasi mereka dalam tiga hingga lima tahun ke depan.

Hasil lain dari penelitian Accenture juga mencatat bahwa para eksekutif Indonesia turut mengantisipasi adanya percepatan inovasi (90%) dan peningkatan pengalaman pelanggan (89%), yang merupakan dua manfaat utama dari penggunaan model dasar AI.

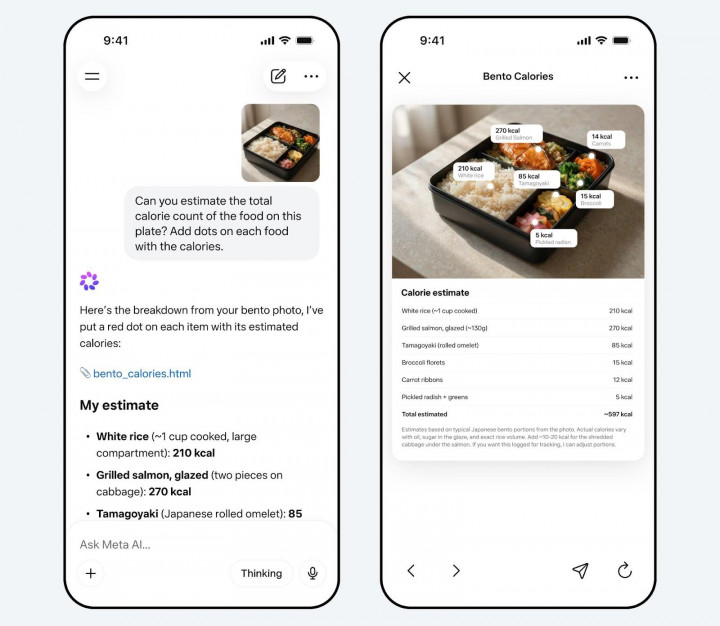

Teknologi AI telah membantu bisnis lintas sektor di Indonesia untuk bertransformasi. Sebagai contoh, beberapa bank di Indonesia telah memanfaatkan teknologi AI untuk mendapatkan informasi mengenai kebutuhan nasabah, meningkatkan layanan pelanggan melalui chatbot, serta mengurangi kemungkinan terjadinya kesalahan pada sistem secara signifikan.

Di sektor e-commerce dan ritel pertumbuhan yang didorong oleh kecerdasan buatan (AI) juga terjadi. Mereka menggunakan chatbot berbasis AI untuk customer support, meluncurkan kampanye pemasaran yang dipersonalisasi sesuai dengan preferensi pelanggan, serta mengintegrasi otomatisasi cerdas untuk efisiensi logistik.

Selain itu, potensi AI juga meluas ke sektor lain, seperti layanan kesehatan, dimana AI memegang peran penting dalam pengelolaan data dan melakukan diagnosis penyakit yang akurat. Hal ini kemudian mendukung terbentuknya sistem pelayanan kesehatan yang lebih berbasis data.

Bagi para eksekutif di Indonesia, pertanyaannya saat ini adalah bagaimana cara mengambil manfaat dengan aman dari kecerdasan buatan generatif, karena baik para pemimpin bisnis maupun karyawan sangat antusias tentang potensinya. Memahami lanskap risiko dan mengambil tindakan proaktif dapat mendorong organisasi untuk memperoleh manfaatnya dengan aman.

Mengetahui potensi serta ancaman yang juga dapat muncul dari inovasi teknologi ini, lantas bagaimana para pemimpin bisnis di Indonesia memanfaatkan AI generatif (Generative AI) dengan aman?

Menciptakan lingkungan yang terpercaya dan meminimalisir risiko kehilangan data: Akses terhadap aplikasi seperti ChatGPT dalam konteks bisnis memiliki potensi kebocoran kekayaan intelektual dan data perusahaan.

Oleh karenanya, perlu pertimbangan yang cermat terhadap kasus penggunaan dan pola aliran data tertentu untuk mengurangi risiko. Sebagai contoh dalam kasus ChatGPT, beberapa risiko terutama berada pada lapisan aplikasi dan bukan pada chat language model.

Perusahaan dapat melakukan mitigasi dengan mengembangkan tampilan antarmuka khusus yang menggunakan model bahasa API tanpa menggunakan aplikasi ChatGPT untuk mengurangi risiko.

Pendekatan lain yang juga dapat dilakukan perusahaan adalah pembuatan sandbox environment untuk mengisolasi data. Sandbox environment dapat berfungsi sebagai gateway yang aman untuk mengakses language model services, dengan filter yang dapat disesuaikan. Hal ini dapat lebih melindungi integritas dan mengurangi tingkat bias data.

Lebih lanjut, bergantung pada sifat studi kasus yang ada, pendekatan ini memungkinkan data yang sensitif tetap berada dalam kendali perusahaan, sementara data yang kurang sensitif dapat ditukar dengan layanan berbasis hosting yang dapat memisahkan data dengan pengaturan mandiri. Mengadopsi pendekatan “trust by design” menjadi kunci dalam membangun dan mengoperasikan sistem yang baik dengan aplikasi kecerdasan buatan generatif.

ChatGPT telah mendorong adopsi AI lebih cepat daripada aplikasi konsumen lain dalam sejarah. Namun ini justru menimbulkan masalah baru. Saat ini sebagian besar karyawan di banyak perusahaan mempelajari teknologi secara mandiri melalui media sosial dan media, sehingga muncul ruang bagi misinformasi. Selain itu, seringkali para karyawan mengakses aplikasi-aplikasi ini melalui smartphone dan laptop pribadi, sehingga mampu menimbulkan ancaman keamanan siber baru.

Oleh karenanya, perusahaan perlu mengerti bahwa ada kebutuhan mendesak akan program pelatihan secara khusus bagi para karyawan. Hal ini menegaskan kebutuhan mendesak akan program pelatihan khusus untuk karyawan guna memastikan bahwa mereka memiliki pengetahuan yang memadai dan keterampilan untuk menjelajahi perkembangan teknologi kecerdasan buatan generatif dengan aman.

Bersikap transparan terhadap data: Bekerja dengan model dasar kecerdasan buatan eksternal atau mengadaptasinya untuk tujuan bisnis tertentu memerlukan pengetahuan akan risiko-risiko terkait data sepanjang siklus hidup modelnya, sambil memberikan prioritas pada transparansi.

Kualitas dan integritas data sangat berdampak pada integritas dan efektivitas sistem AI generatif. Risiko-risiko tersebut dapat mencakup masalah seperti plagiarisme, pelanggaran hak cipta, dan bias, baik yang tidak sengaja maupun yang disengaja. Bisnis harus mampu mengidentifikasi dan menilai risiko-risiko data ini, termasuk sumber-sumber dan potensi cacat atau bias, untuk dapat membangun kepercayaan dalam AI.

Walaupun terdapat beberapa alat dan teknik untuk mengevaluasi pelatihan data, menghilangkan risiko secara menyeluruh selalu menjadi tantangan. Dalam jangka pendek, transparansi muncul sebagai solusi utama.

Berbagi detail secara terbuka mengenai data yang digunakan dalam pelatihan model dan proses AI generatif akan menumbuhkan kejelasan dan kepercayaan. Selain itu, dengan adanya pedoman yang jelas mengenai bias, privasi, hak kekayaan intelektual, asal usul, dan transparansi dapat membantu karyawan dalam mengambil keputusan mengenai pemanfaatan teknologi kecerdasan buatan generatif.

Untuk mempertahankan keberlangsungan kecerdasan buatan untuk semua pihak, kita harus terus memanfaatkannya untuk tujuan yang baik. Dan kita pun dapat menggunakannya untuk membantu meningkatkan penggunaan bisnis dari kecerdasan buatan generatif secara keseluruhan. Salah satu hal konkret yang dapat dilakukan adalah dengan melibatkan peran manusia demi menambah unsur keamanan dan memastikan adanya pemeriksaan ‘kewarasan’ terhadap respons yang diberikan.

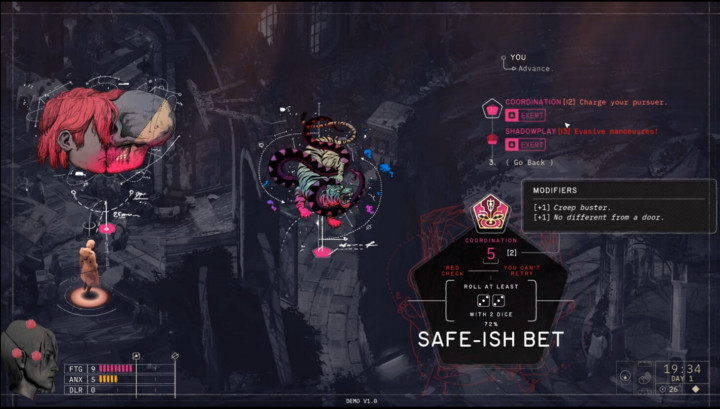

Reinforcement learning with human feedback (RLHF) mampu melakukan penyesuaian berdasarkan peringkat manusia, dari perintah yang sama. Model AI rentan terhadap serangan dan dapat disusupi untuk tujuan berbahaya, seperti serangan “prompt injection”.

Dalam serangan ini, model kerapkali dimanipulasi untuk memberikan respons yang salah atau berbahaya, sehingga berpotensi mengambil alih kendali developer.

Hal ini dapat terjadi melalui prompt yang menyesatkan yang mencakup instruksi tersembunyi, yang merupakan ancaman yang harus diatasi oleh para pemimpin bisnis dengan mengembangkan langkah-langkah keamanan yang kuat untuk model-model itu sendiri.

Kecerdasan Buatan generatif dan model dasar AI (foundation models) merupakan pondasi penting dalam pengembangan Kecerdasan Buatan. Potensinya hampir tanpa batas. Namun, ada pula risiko dan ancaman yang baru. Para pemimpin bisnis perlu memahami risiko-risiko ini dan segera mengambil tindakan untuk meminimalkannya.

Terdapat model kerangka kerja dan teknologi yang terus berkembang untuk membantu memandu program AI dengan kepercayaan, keamanan, dan privasi secara keseluruhan. Penting diketahui bahwa dibutuhkan strategi dan kolaborasi AI yang dapat dipercaya, kepercayaan berdasarkan desain dan pemantauan yang berkelanjutan agar dapat membangun dan mengoperasikan sistem AI yang sukses.

Pada akhirnya, yang menjadi tujuan dasar utama adalah memanfaatkan kekuatan generatif AI dengan cara yang aman untuk memberikan nilai bagi bisnis lokal, serta meningkatkan taraf hidup semua orang yang menggunakannya.

(Budiono, Managing Director, Applied Intelligence, Accenture Indonesia)

Cek Berita dan Artikel yang lain di

Google News