Sejak itu, kami telah melihat bagaimana AI dan, lebih khusus lagi, deep learning telah membuat kemajuan signifikan dalam memajukan banyak bidang, termasuk medis, layanan keuangan, dan manufaktur.

Kami juga telah melihat bagaimana kemajuan pesat model bahasa besar (LLM) dan peningkatan akses ke aplikasi AI generatif telah mengubah dunia. Saat ini, alat AI yang kuat dapat diakses oleh orang-orang tanpa keterampilan AI formal.

Hal ini memungkinkan orang-orang di seluruh dunia untuk menemukan dan menggunakan kemampuan AI dalam skala besar, meningkatkan cara mereka bekerja, belajar, dan bermain. Meskipun ini telah menciptakan peluang luar biasa untuk inovasi, ada juga peningkatan kekhawatiran seputar penyalahgunaan, keamanan, bias, dan informasi yang salah.

Untuk semua alasan ini, praktik AI yang bertanggung jawab lebih penting dari sebelumnya. Kami di Intel percaya bahwa pengembangan yang bertanggung jawab harus menjadi dasar inovasi di seluruh siklus hidup AI untuk memastikan AI dibangun, diterapkan, dan digunakan dengan cara yang aman, berkelanjutan, dan etis. Karena AI terus berkembang pesat, begitu pula upaya RAI kami.

Tata Kelola Internal dan Eksternal

Bagian penting dari strategi RAI kami adalah menggunakan proses tinjauan multidisiplin yang ketat di seluruh siklus hidup AI. Secara internal, dewan penasihat Intel meninjau berbagai aktivitas pengembangan AI melalui lensa prinsip-prinsip dasar:

1. Menghormati hak asasi manusia

2. Aktifkan pengawasan manusia

3. Aktifkan transparansi dan penjelasan

4. Keamanan, keselamatan, dan keandalan yang lebih baik

5. Desain untuk privasi

6. Mempromosikan kesetaraan dan inklusi

7. Lindungi lingkungan

Banyak yang telah berubah dengan ekspansi AI generatif yang cepat, dan kami telah berubah dengan itu. Dari mengembangkan panduan tetap tentang penerapan internal LLM yang lebih aman, hingga meneliti dan mengembangkan taksonomi tentang cara-cara spesifik AI generatif dapat menyesatkan orang dalam situasi dunia nyata, kami bekerja keras untuk tetap berada di depan risiko.

Dengan perluasan AI generatif juga muncul kekhawatiran tentang dampak lingkungan dari AI, jadi kami telah menambahkan "lindungi lingkungan" sebagai prinsip dasar baru, konsisten dengan komitmen penatalayanan lingkungan Intel yang lebih luas. Meskipun tidak ada yang sederhana tentang mengatasi area yang kompleks ini, AI yang bertanggung jawab tidak pernah simpel. Pada tahun 2017, kami berkomitmen untuk mengatasi bias bahkan ketika metode masih dikembangkan untuk mengatasinya.

Penelitian dan Kolaborasi

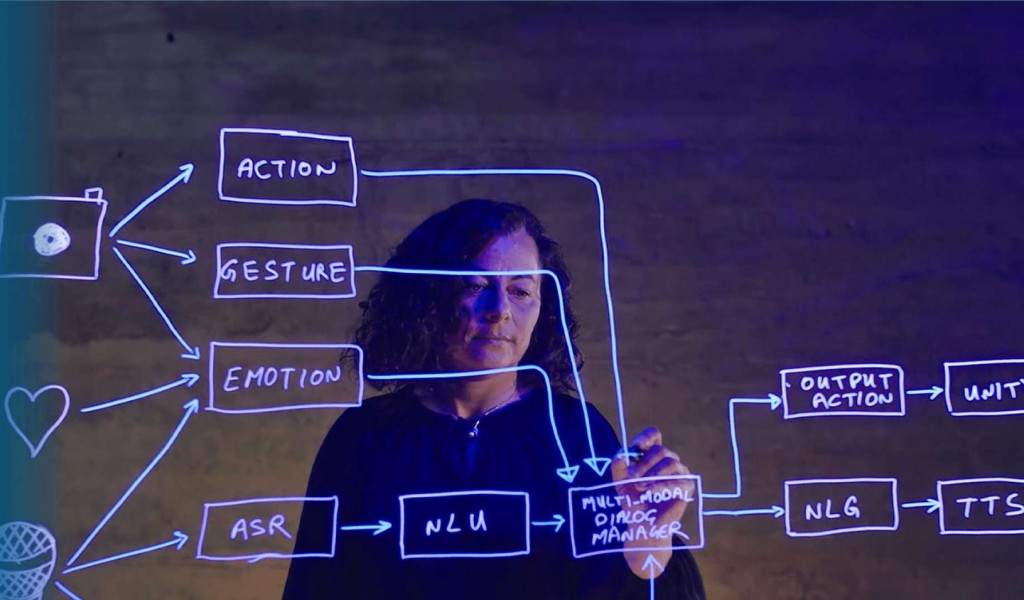

Terlepas dari kemajuan besar yang telah dibuat dalam AI yang bertanggung jawab, ini masih merupakan bidang yang baru lahir. Kita harus terus memajukan keadaan seni, terutama mengingat peningkatan kompleksitas dan kapasitas model terbaru. Di Intel Labs, kami berfokus pada bidang penelitian utama termasuk privasi, keamanan, keselamatan, kolaborasi manusia/AI, misinformasi, keberlanjutan AI, penjelasan, dan transparansi.

Kami juga berkolaborasi dengan lembaga akademik di seluruh dunia untuk memperkuat dampak pekerjaan kami. Baru-baru ini kami mendirikan Intel Center of Excellence on Responsible Human-AI Systems (RESUMAIS). Upaya multi-tahun ini menyatukan empat lembaga penelitian terkemuka: di Spanyol, Laboratorium Eropa untuk Pembelajaran dan Sistem Cerdas (ELLIS) Alicante; dan di Jerman, DFKI, Pusat Penelitian Jerman untuk Kecerdasan Buatan, Pusat Penelitian FZI untuk Teknologi Informasi dan Leibniz Universität Hannover.

RESUMAIS bertujuan untuk mendorong pengembangan AI yang etis dan berpusat pada pengguna, dengan fokus pada isu-isu seperti keadilan, kolaborasi manusia/AI, akuntabilitas, dan transparansi.

Kami juga terus membuat dan berpartisipasi dalam beberapa aliansi di seluruh ekosistem untuk menghasilkan solusi, standar, dan tolok ukur untuk mengatasi masalah baru dan kompleks yang berkaitan dengan RAI. Keterlibatan kami dalam Kelompok Kerja Keselamatan AI MLCommons, Aliansi AI, kelompok kerja Kemitraan tentang AI, Meja Bundar Bisnis tentang Hak Asasi Manusia dan AI, dan inisiatif multipihak lainnya telah berperan penting dalam memajukan pekerjaan ini – tidak hanya sebagai perusahaan, tetapi sebagai industri.

AI Inklusif/Membawa AI Ke Mana Saja

Intel percaya bahwa membawa "AI Di Mana Saja" secara bertanggung jawab adalah kunci untuk kemajuan kolektif bisnis dan masyarakat. Keyakinan ini adalah dasar dari pemrograman kesiapan digital Intel, yang bekerja untuk menyediakan akses ke keterampilan AI kepada semua orang, terlepas dari lokasi, etnis, jenis kelamin, atau latar belakang.

Kami bangga memperluas program AI untuk Pemuda dan Tenaga Kerja kami untuk memasukkan kurikulum seputar etika terapan dan kelestarian lingkungan. Selain itu, di Festival Dampak Global AI tahunan ketiga Intel, proyek pemenang melalui audit etika yang terinspirasi oleh proses multidisiplin Intel. Festival juga menampilkan pelajaran di mana lebih dari 4.500 siswa memperoleh sertifikasi dalam keterampilan AI yang bertanggung jawab. Dan, untuk pertama kalinya, penghargaan diberikan kepada tim proyek yang memberikan solusi aksesibilitas inovatif menggunakan AI.

Melihat ke depan

Kami memperluas upaya kami untuk memahami dan mengurangi risiko unik yang diciptakan oleh ekspansi besar-besaran AI generatif dan untuk mengembangkan pendekatan inovatif untuk mengatasi keselamatan, keamanan, transparansi, dan kepercayaan.

Kami juga bekerja sama dengan organisasi Supply Chain Responsibility kami untuk mempercepat kemajuan dalam menangani hak asasi manusia pekerja pengayaan data global AI (yaitu, orang-orang yang membuat kumpulan data AI dapat digunakan melalui pelabelan, pembersihan, anotasi, atau validasi).

Mengatasi masalah kritis ini akan membutuhkan upaya di seluruh industri, dan kami memanfaatkan pengalaman kami selama dua dekade dalam menangani masalah seperti pengadaan yang bertanggung jawab dan kerja paksa untuk membantu memajukan ekosistem global.

Di seluruh AI yang bertanggung jawab, kami berkomitmen untuk mempelajari pendekatan baru, berkolaborasi dengan mitra industri, dan melanjutkan pekerjaan kami. Hanya dengan begitu kita dapat benar-benar membuka potensi dan manfaat AI.

(Lama Nachman, Intel Fellow dan Direktur Intelligent Systems Research Lab Intel Labs)

Cek Berita dan Artikel yang lain di

Google News